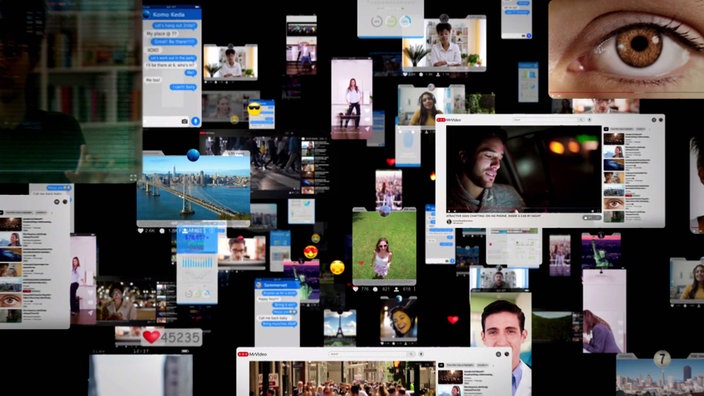

Eine gefälschte Videoansprache von Kanzler Olaf Scholz, eine real wirkende Szene mit Donald Trump, wie er vor der Polizei flüchtet oder Putin, der vor dem chinesischen Machthaber kniet. Das alles kursierte längst im Netz, wurde millionenfach geteilt und hat doch so nie wirklich stattgefunden. Künstliche Intelligenz erstellt nicht nur Texte und Bilder, sondern auch Töne und Videos, die von echten Aufnahmen kaum zu unterscheiden sind.

KI verwischt mitunter die Grenzen zwischen Wahrheit und Simulation. Das bietet ungeheuren Spielraum, kann aber auch Gefahr bedeuten, etwa in Form gezielter Manipulation. Durch KI erzeugte Inhalte könnten Meinungen machen, Stimmungen drehen und am Ende sogar Wahlen beeinflussen.

Politik mit Fakefotos: Wie die AfD KI nutzt

Politische Aussagen durch Fake-Fotos

In TikTok-Profilen, auf Facebook oder Instagramseiten von AfD-Mitgliedern oder deren Kreisverbänden finden sich jede Menge bunter Videoschnipsel und Bilder, auf denen griffige Schlagzeilen prangen. Die Fotos zeigen zum Beispiel eine Gruppe aggressiver Flüchtlinge, einen dunkelhäutigen Mann, der eine verängstigte Frau verfolgt, oder die Partei wirbt mit dem Gesicht einer Frau namens Stefanie Müller, die in einem nebenstehenden Zitat erklärt, warum sie die AfD wählt.

Angebliche AfD-Wählerin

Den drei Bilder ist gemein: Sie sind nicht echt. Eine KI hat sie generiert. Die Partei AfD nutzt diese Deepfakes, um eigene Statements zu illustrieren und damit Stimmung zu machen. Auch die dargestellte "Stefanie Müller" existiert nicht. Bei genauerem Hinsehen wirkt die Mundpartie unecht, auch die Nase passt nicht. Ob das Zitat authentisch ist, bleibt unklar. Dennoch halten User, die das Bild auf einer Facebookseite der AfD im Staufenkreis Göppingen finden, für real. "Mutige junge Frau", kommentiert jemand darunter.

Forscher: AfD hat keine Angst vor Kontroverse

Politikwissenschaftler Andreas Jungherr

Dass gerade die AfD die Technik in dieser Weise nutzt, ist für den Politikwissenschaftler Andreas Jungherr keine Überraschung. "Ich glaube, das hängt ein Stück weit damit zusammen, dass wir es hier mit einer Partei zu tun haben, die keine Angst vor der Kontroverse haben muss, weil sie ohnehin schon sehr negativ oder auch sehr kontrovers in der Öffentlichkeit diskutiert wird. Ob oder wie sie dann KI im Wahlkampf einsetzt, ist da eben nur noch ein weiterer Baustein."

KI im deutschen Wahlkampf?

Was ist harmlose Illustration und wo beginnt die Manipulation? Der WDR hat auch andere Parteien angefragt, wie sie KI im Wahlkampf nutzen. Die Antworten sind sehr unterschiedlich. Die CDU sagt, man habe noch nicht entschieden, ob und wie man KI einsetzt – wenn, dann gesetzeskonform und transparent. Ähnlich äußern sich SPD und FDP. Die Grünen nutzen KI zur Datenanalyse, aber nicht für Bilder von Personen. Die Linke verwendet schon KI-generierte Bilder im Wahlkampf, jedoch gekennzeichnet. Die Parteien beginnen also gerade, ihr Verhältnis zu KI zu klären.

Wenn die KI Schlagzeilen macht: Blick in die USA

Will Harris wählen: Instagrampost von Taylor Swift

In den USA läuft gerade der Wahlkampf um das Präsidentenamt auf Hochtouren. In den Staaten sorgt KI-generierter Inhalt immer mal wieder für Schlagzeilen. So behauptete Donald Trump kürzlich, Taylor Swift und ihre Fans würden ihn unterstützen – belegt mit gefälschten Bildern. Swift unterstützt aber die Demokraten - und ihre Fans registrieren sich massenweise für die Wahl.

Deepfake-Videos: Erkennst du die Fälschung?

11:34 Min.. Verfügbar bis 30.12.2099.

Eine subtilere Technik ist der Einsatz von Bots, die sich in sozialen Medien als echte Menschen ausgeben. Bei den letzten US-Wahlen waren sie noch leicht zu erkennen, da ihre Beiträge oft grammatikalisch falsch oder kontextlos waren. Heute fluten KI-Bots fehlerfrei in hunderten Sprachen die Netzwerke, antworten auf Fragen und beeinflussen so die Wählerschaft.

Gleicht die Politik also einer Fake-Reality? Nicht unbedingt, sagt Politikwissenschaftler Andreas Jungherr. Es könne nämlich sein, dass gerade die allgemeine Verfügbarkeit von KI Politiker künftig dazu anhalte, wieder besonderen Wert auf Authentizität von Bilden und persönlicher Ansprache zu legen, um sich damit von anderen Kandidaten abzusetzen.

AI-Act der EU: Wettlauf mit der Zeit

Doch zunächst steht die politische Glaubwürdigkeit auf dem Spiel. Denn künstlich erstellte Bilder oder Texte können die Wahrheit verzerren, indem sie Vorurteile in den Köpfen verdichten. Was also tun gegen diese immer größer werdende Flut von Fake News?

Längst wird der Ruf nach mehr Regulierung laut. Bereits im März 2023 hatten 1.000 Forscher und Unternehmer in einem offenen Brief eine Entwicklungspause gefordert. Damit sollte die Branche Zeit bekommen, Sicherheitsstandards für die Entwicklung von KI festzulegen und mögliche Schäden durch die riskantesten KI-Technologien abzuwenden.

Auch die EU will die Bürger vor den Gefahren der Künstlichen Intelligenz schützen. Mit einem Gesetz, dem sogenannten "AI-Act". Es ist die erste KI-Gesetzgebung dieser Art weltweit. Unter anderem sollen KI-Systeme demnach so entwickelt sein, dass Risiken wie Manipulationen minimiert werden. Auch müssen durch KI erzeugte Inhalte gekennzeichnet werden. Facebook hat im Mai bereits damit begonnen, mit KI erzeugte fotorealistische Bilder mit dem Hinweis "Made with AI" zu kennzeichnen.

Dieses Gesetz ist zum 1. August 2024 in Kraft getreten und soll schrittweise greifen. Erst im August 2026 sollen alle neuen Regeln wirksam sein. Alle EU-Staaten müssen die Regeln bis dahin in ihrer Gesetzgebung umsetzen.

Zu der Themenreihe "Unser Leben mit KI" zeigt das WDR-Fernsehen am 25. September 2024 um 22.15 Uhr die Sendung "Wie uns künstliche Intelligenz täuscht."

![Symbolbild: Schaltkreise, Umriss eines Gehirns und die Buchstaben KI | Bildquelle: WDR/Philipp Bösel [KI] Adobe Stock Symbolbild: Schaltkreise, Umriss eines Gehirns und die Buchstaben KI](/ki/ki-symbol-brain-100~_v-ARDGrosserTeaser.jpg)

![Symbolbild: Schaltkreise, Umriss eines Gehirns und die Buchstaben KI | Bildquelle: WDR/Philipp Bösel [KI] Adobe Stock Symbolbild: Schaltkreise, Umriss eines Gehirns und die Buchstaben KI](/ki/ki-symbol-brain-100~_v-ARDKleinerTeaser.jpg)